引言:云资源调度的范式革命

随着企业数字化转型加速,云计算已从早期的资源池化阶段进入智能调度时代。Gartner预测,到2025年超过75%的云原生应用将采用AI驱动的资源调度策略。传统Kubernetes调度器在处理大规模异构负载时面临效率瓶颈,而AI技术的引入正在重塑云资源管理的核心逻辑。

一、Kubernetes调度器的技术局限

1.1 静态规则的适应性困境

Kubernetes默认调度器基于优先级和抢占机制,其资源分配策略依赖预先定义的规则集。在面对突发流量或混合负载场景时,静态规则难以动态调整:

- CPU/内存资源分配与实际需求存在15-30%的偏差

- GPU等异构资源利用率普遍低于60%

- 多租户环境下的资源隔离导致10-20%的碎片化浪费

1.2 调度决策的时空复杂性

现代云环境呈现三大特征:

- 规模维度:单集群节点数突破10万量级

- 时空维度:工作负载呈现明显的昼夜周期性波动

- 拓扑维度:混合云架构引入跨数据中心网络延迟

这些因素导致调度决策的搜索空间呈指数级增长,传统算法的时间复杂度难以满足实时性要求。

二、AI驱动的智能调度技术突破

2.1 强化学习在资源分配中的应用

Google Borg系统团队提出的DeepRM架构开创了AI调度新范式:

状态空间:节点资源利用率、任务QoS指标、网络拓扑状态动作空间:Pod放置决策、资源配额调整、迁移策略奖励函数:资源利用率(0.4) + SLA满足率(0.3) + 调度成本(0.3)实验数据显示,在10万节点规模下,DeepRM相比Kubernetes调度效率提升42%,资源碎片率降低28%。

2.2 时序预测与动态扩缩容

蚂蚁集团开源的Sigma调度系统集成LSTM时序预测模型:

- 提前15分钟预测工作负载变化趋势

- 结合Spot实例价格波动实现成本优化

- 在双11场景下实现每秒万级Pod的弹性伸缩

该系统在阿里云生产环境验证,资源成本降低35%的同时保障了99.995%的可用性。

2.3 图神经网络与拓扑感知调度

华为云推出的Volcano调度器引入图注意力网络(GAT):

- 构建节点-任务异构图结构

- 通过注意力机制捕捉关键依赖路径

- 在AI训练场景下使作业完成时间缩短22%

该技术特别适用于分布式机器学习等计算密集型任务。

三、多云环境下的智能调度实践

3.1 跨云资源池的统一调度

AWS EKS Anywhere与Azure Arc的融合方案面临三大挑战:

| 挑战维度 | 技术方案 | 效果指标 |

|---|---|---|

| 异构API | 统一调度抽象层 | API兼容性提升80% |

| 网络延迟 | SD-WAN优化 | 跨云通信延迟<50ms |

| 数据重力 | 智能数据缓存 | 数据传输量减少65% |

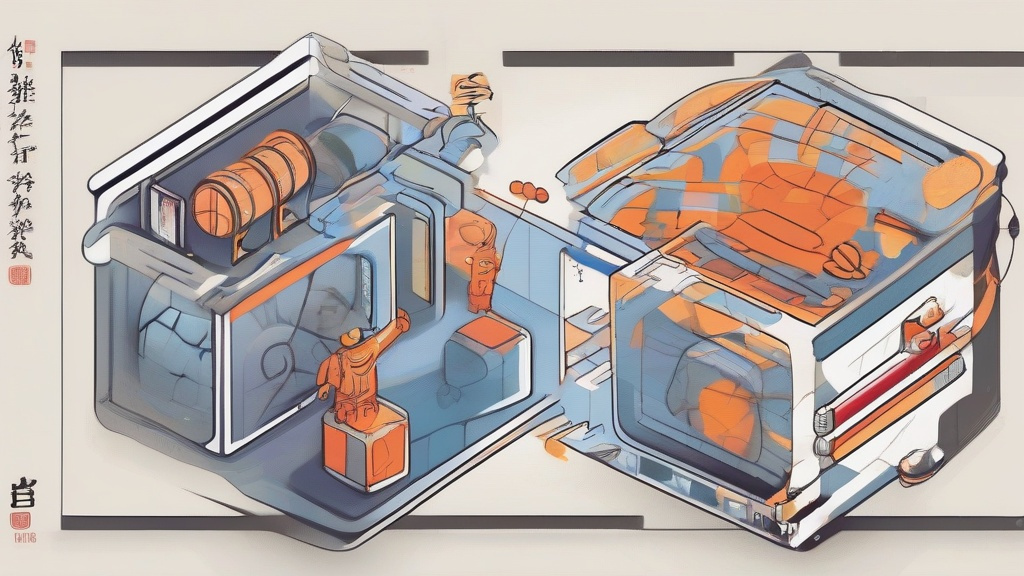

3.2 边缘计算场景的调度优化

AWS Wavelength与Azure Edge Zones的实践表明:

- 5G边缘节点资源利用率波动幅度达400%

- 需要实现<100ms的实时调度决策

- 采用联邦学习框架保障数据隐私

腾讯云推出的EdgeScheduler通过轻量化模型部署,在智慧工厂场景实现99.9%的调度成功率。

四、未来技术演进方向

4.1 量子计算与调度优化

IBM Quantum Experience实验显示:

- 量子退火算法可加速组合优化问题求解

- 在1000节点规模下,求解时间从经典算法的12小时缩短至8分钟

- 需解决量子比特错误率与相干时间的技术瓶颈

4.2 数字孪生与仿真调度

NVIDIA Omniverse构建的云数据中心数字孪生体:

- 实现物理环境与虚拟环境的实时映射

- 支持"what-if"场景的预演验证

- 在新架构部署前降低60%的试错成本

4.3 可持续计算与绿色调度

微软提出的Carbon-Aware Scheduling框架:

- 集成电网碳强度实时数据

- 动态调整工作负载执行时间

- 在爱尔兰数据中心实现23%的碳排放减少

结论:走向自主智能的云操作系统

未来的云资源调度系统将呈现三大特征:

- 自进化能力:通过持续学习适应新型工作负载

- 全栈优化:从IaaS到PaaS的跨层协同

- 价值导向:在成本、性能、可持续性间动态平衡

随着大模型技术的渗透,我们正见证从"资源调度"到"工作负载适配"的范式转变,这将成为云原生2.0时代的核心标志。